Що таке лінійна регресія в R?

Лінійна регресія - це найпопулярніший і широко застосовуваний алгоритм у галузі статистики та машинного навчання. Лінійна регресія - це метод моделювання для розуміння взаємозв'язку між вхідними та вихідними змінними. Тут змінні повинні бути числовими. Лінійна регресія походить від того, що вихідна змінна є лінійною комбінацією вхідних змінних. Вихідний сигнал, як правило, представлений символом "y", тоді як вхідний сигнал представлений "x".

Лінійну регресію в R можна класифікувати двома способами

-

Лінійна регресія

Це регресія, де вихідна змінна є функцією однієї вхідної змінної. Представлення простої лінійної регресії:

y = c0 + c1 * x1

-

Множинна лінійна регресія

Це регресія, де вихідна змінна є функцією змінної з декількома входами.

y = c0 + c1 * x1 + c2 * x2

В обох вищезазначених випадках c0, c1, c2 є коефіцієнтом, який представляє ваги регресії.

Лінійна регресія в R

R - дуже потужний статистичний інструмент. Отже, давайте подивимось, як може виконуватися лінійна регресія в R та як можна інтерпретувати її вихідні значення.

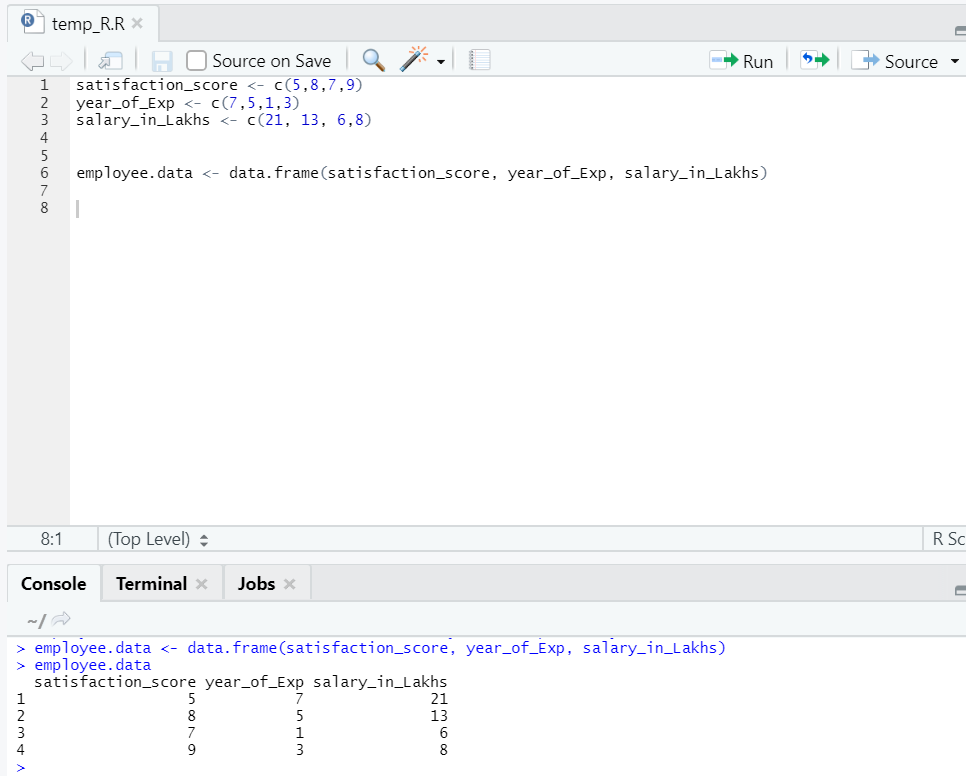

Давайте підготуємо набір даних, щоб зараз виконувати та розуміти лінійну регресію.

Тепер у нас є набір даних, де "satis_score" та "year_of_Exp" є незалежною змінною. "Зарплата_in_lakhs" є вихідною змінною.

Посилаючись на вищезазначений набір даних, проблема, яку ми хочемо вирішити тут за допомогою лінійної регресії, полягає в:

Оцінка зарплати працівника, виходячи з його року досвіду та оцінки задоволеності в його компанії.

R код лінійної регресії:

model <- lm(salary_in_Lakhs ~ satisfaction_score + year_of_Exp, data = employee.data)

summary(model)

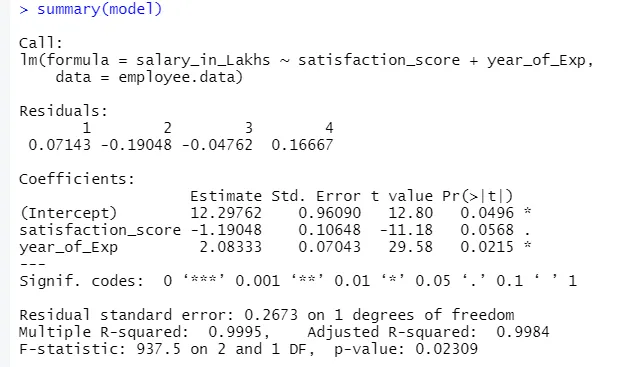

Вихід з вищевказаного коду буде:

Формула регресії стає

Y = 12, 29-1, 19 * задоволення_скорею + 2, 08 × 2 * рік_вибігу

У випадку, якщо один має кілька входів у модель.

Тоді R-код може бути:

модель <- lm (зарплата_in_Lakhs ~., дані = співробітник.дані)

Однак, якщо хтось хоче вибрати змінну з декількох змінних вхідних даних, для цього також доступні кілька методів, таких як "Зворотнє усунення", "Вибір вперед" тощо.

Інтерпретація лінійної регресії в R

Нижче наведено деякі інтерпретації лінійної регресії в r, які наступні:

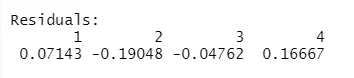

1. Рештки

Це стосується різниці між реальною відповіддю та передбачуваною реакцією моделі. Отже, для кожного пункту буде одна реальна відповідь та одна передбачувана відповідь. Отже, залишків буде стільки, скільки спостережень. У нашому випадку у нас є чотири спостереження, отже, чотири залишки.

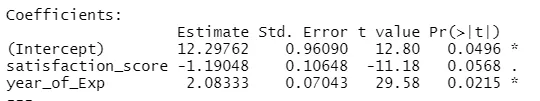

2.Коефіцієнти

Просунувшись далі, ми знайдемо розділ коефіцієнтів, на якому зображено перехоплення та нахил. Якщо потрібно прогнозувати зарплату працівника на основі його досвіду та рівня задоволеності, потрібно розробити модельну формулу на основі нахилу та перехоплення. Ця формула допоможе вам у прогнозуванні зарплати. Перехоплення і нахил допомагають аналітику придумати найкращу модель, яка влучно підходить для точок даних.

Нахил: зображує крутизну лінії.

Перехоплення: місце, де лінія перерізає вісь.

Давайте розберемося, як відбувається формування формули на основі нахилу та перехоплення.

Скажіть, перехоплення - 3, а нахил - 5.

Отже, формула y = 3 + 5x . Це означає, що якщо x збільшено на одиницю, y збільшується на 5.

a. Коефіцієнт - кошторис

У цьому перехоплення позначає середнє значення вихідної змінної, коли весь вхід стає нульовим. Так, у нашому випадку зарплата в лаках складе 12, 29 лахів як середня, враховуючи показник задоволеності та досвід, що дорівнює нулю. Тут нахил представляє зміну вихідної змінної з одиничною зміною вхідної змінної.

b. Коефіцієнт - Стандартна помилка

Стандартна помилка - це оцінка помилки, яку ми можемо отримати при обчисленні різниці між фактичним та прогнозованим значенням нашої змінної відповіді. У свою чергу, це говорить про впевненість у взаємозв'язку змінних вводу та виводу.

c. Коефіцієнт - t значення

Це значення дає впевненість відкинути нульову гіпотезу. Чим більше значення від нуля, тим більша впевненість у відхиленні нульової гіпотези та встановлення зв’язку між змінною виводу та введення. У нашому випадку значення також відпадає від нуля.

d.Coefficient - Pr (> t)

Ця абревіатура в основному зображує значення р. Чим ближче до нуля, тим легше ми можемо відкинути нульову гіпотезу. Рядок, який ми бачимо в нашому випадку, це значення майже до нуля, ми можемо сказати, що існує залежність між пакетом зарплат, показником задоволеності та роком досвіду.

Залишкова стандартна помилка

Це зображує помилку в прогнозуванні змінної відповіді. Чим вона нижча, тим вище точність моделі.

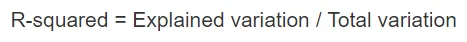

Кілька R-квадратів, Регульований R-квадрат

R-квадрат є дуже важливим статистичним показником для розуміння того, наскільки тісні дані вписуються в модель. Отже, в нашому випадку, наскільки добре наша лінійна регресія представляє набір даних.

Значення R-квадрата завжди лежить між 0 і 1. Формула така:

Чим ближче значення до 1, тим краще модель описує набори даних та їх дисперсію.

Однак, коли на малюнок надходить більше однієї вхідної змінної, коригується значення R квадрата.

F-статистика

Це сильна міра визначити залежність між вхідною та змінною відповіді. Чим більше значення, ніж 1, тим вище впевненість у взаємозв'язку між вхідною та вихідною змінною.

У нашому випадку його «937, 5», що порівняно більше, враховуючи розмір даних. Отже, відхилення нульової гіпотези стає простішим.

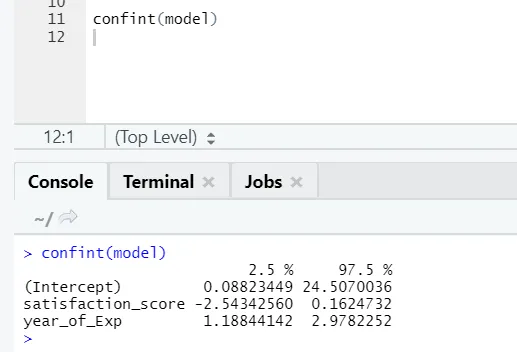

Якщо хтось хоче побачити інтервал довіри для коефіцієнтів моделі, ось як це зробити:

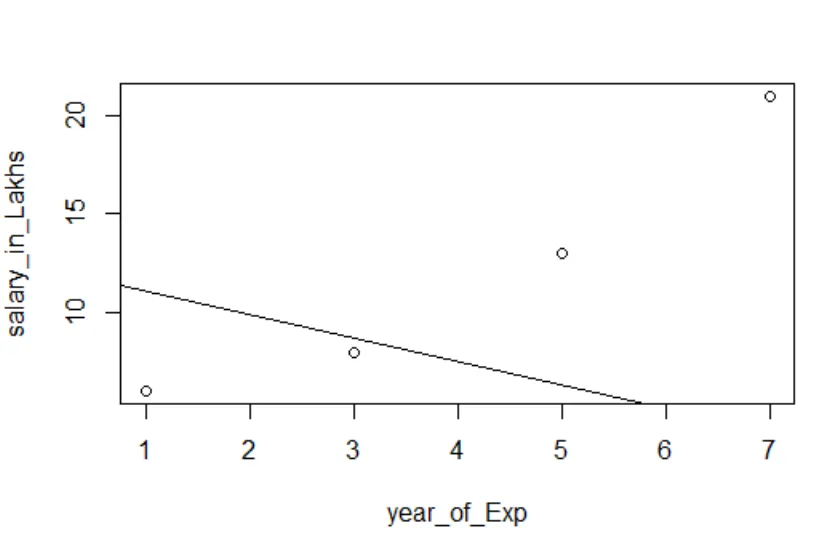

Візуалізація регресії

R код:

сюжет (зарплата_в_Лахс ~ задоволення_скорення + рік_обігу_даного, дані = працівник.дані)

абліна (модель)

Завжди краще набирати все більше і більше балів, перш ніж підходити до моделі.

Висновок - лінійна регресія в R

Лінійна регресія - це проста, зручна в роботі, легко зрозуміла, але дуже потужна модель. Ми бачили, як можна виконати лінійну регресію на Р. Ми також спробували інтерпретувати результати, які можуть допомогти вам в оптимізації моделі. Як тільки вам стає комфортно з простою лінійною регресією, слід спробувати багаторазову лінійну регресію. Поряд з цим, оскільки лінійна регресія чутлива до людей, що переживають людину, потрібно переглядати її, перш ніж переходити безпосередньо до лінійної регресії.

Рекомендовані статті

Це посібник з лінійної регресії в Р. Тут ми обговорили, що таке лінійна регресія в R? категоризація, візуалізація та інтерпретація Р. Ви також можете ознайомитись з іншими запропонованими нами статтями, щоб дізнатися більше -

- Прогностичне моделювання

- Логістична регресія в R

- Дерево рішень в R

- R Питання для співбесіди

- Основні відмінності регресії від класифікації

- Керівництво по дереву рішень в машинному навчанні

- Лінійна регресія проти логістичної регресії | Основні відмінності