Вступ до методів ядра в машинному навчанні

Алгоритм, що використовується для аналізу шаблону, називається методом ядра в машинному навчанні. За загальною схемою аналіз проводиться для пошуку співвідношень у наборах даних. Ці відносини можуть бути кластеризацією, класифікацією, основними компонентами, кореляцією і т. Д. Більшість цих алгоритмів, які вирішують ці завдання аналізу структури, потребують даних у сировинному представнику, щоб бути явно перетвореними у векторне представлення ознак. Це перетворення можна здійснити за вказаною користувачем картою функцій. Отже, можна вважати, що методом ядра потрібно лише вказане користувачем ядро.

Термінологічний метод Kernal походить від того, що вони використовують функцію ядра, що дозволяє виконувати операцію у високомірному, неявному просторі функцій без необхідності обчислення координат даних у цьому просторі. Натомість вони просто обчислюють внутрішній продукт між зображеннями всіх пар даних у просторі зображень.

Такі види операцій в більшості випадків обчислюються дешевше порівняно з чітким обчисленням координат. Цей прийом називають «фокусом ядра». Будь-яка лінійна модель може бути перетворена в нелінійну модель, застосовуючи фокус ядра до моделі.

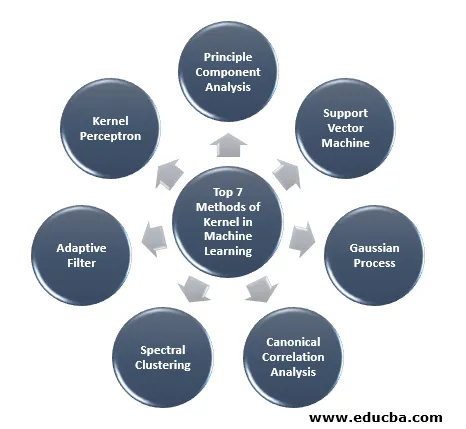

Метод ядра, доступний у машинному навчанні, - це аналіз основних компонентів (PCA), спектральне кластеризація, підтримуючі векторні машини (SVM), канонічний кореляційний аналіз, перцептрон ядра, гауссові процеси, регресія хребта, лінійні адаптивні фільтри та багато інших. Давайте розберемося на високому рівні щодо кількох цих методів ядра.

Топ 7 методів роботи ядра в машинному навчанні

Ось методи ядра в машинному навчанні згадуються нижче:

1. Принциповий аналіз компонентів

Аналіз основних компонентів (PCA) - це метод вилучення структури з можливо великих розмірних наборів даних. Це легко виконується за допомогою ітеративних алгоритмів, що оцінюють основні компоненти, або вирішуючи задачу власного значення. PCA - це ортогональне перетворення системи координат, в якій ми описуємо наші дані. Нова система координат отримується проекцією на основні осі даних. Невелика кількість основних компонентів часто є достатньою для обліку більшої частини структури в даних. Одним з його головних застосувань є проведення дослідницького аналізу даних для складання прогнозної моделі. Він здебільшого використовувався для візуалізації взаємозв'язку між популяціями та генетичною дистанцією.

2. Підтримка векторної машини

SVM можна визначити як класифікатор для розділення гіперплану, де гіперплан є підпростором на один вимір менше, ніж навколишній простір. Розміри цього математичного простору визначаються як мінімальна кількість координат, необхідних для визначення будь-якої точки, тоді як навколишній простір - це простір, який оточує математичний об’єкт. Тепер Математичний об'єкт можна розуміти як абстрактний об'єкт, який не існує ні в один час, ні в місці, але існує як тип речі.

3. Гауссовий процес

Гауссовий процес був названий на честь Карка Фрідріха Гаусса, оскільки він використовує позначення гауссового розподілу (нормальний розподіл). Це стохастичний процес, який означає сукупність випадкових змінних, індексованих часом або простором. У Гауссовому процесі випадкові величини мають багатоваріантний нормальний розподіл, тобто всі кінцеві лінійні їх комбінації нормально розподіляються. У процесі Гаусса використовуються властивості, успадковані від нормального розподілу, і тому вони корисні при статистичному моделюванні. Алгоритм машинного навчання, що включає цей метод ядра, використовує міру ледачого навчання та подібність між балами, щоб передбачити значення невидимих балів з даних навчальних даних. Цей прогноз є не лише оцінкою, але й невизначеністю на той момент.

4. Канонічний кореляційний аналіз

Канонічний кореляційний аналіз - це спосіб виведення інформації з перехресних коваріаційних матриць. Він також відомий як канонічний аналіз змінних. Припустимо, у нас є два вектора X, Y випадкової величини, які говорять про два вектори X = (X1, …, Xn) і вектор Y = (Y1, …, Ym), і змінна, що має кореляцію, тоді CCA обчислить лінійну комбінацію X і Y, що має максимальну кореляцію між собою.

5. Спектральна кластеризація

У застосуванні сегментації зображень спектральна кластеризація відома як категоризація об'єктів на основі сегментації. У спектральному кластеризації зменшення розмірності проводиться перед кластеризацією в меншій мірі, це робиться за допомогою власного значення матриці подібності даних. Він має своє коріння в теорії графів, де цей підхід використовується для ідентифікації спільнот вузлів у графі, який базується на ребрах, що їх з'єднують. Цей метод є досить гнучким і дозволяє нам також кластеризувати дані з не-графіків.

6. Адаптивний фільтр

Адаптивний фільтр використовує лінійний фільтр, який містить функцію передачі, яка керується змінними параметрами та методами, які будуть використовуватися для налаштування цих параметрів відповідно до алгоритму оптимізації. Складність цього алгоритму оптимізації є причиною того, що весь адаптивний фільтр - це цифровий фільтр. Адаптивний фільтр потрібен у тих програмах, де немає попередньої інформації про бажану операцію обробки або вони змінюються.

Функція витрат використовується у адаптивному фільтрі із замкнутим циклом, оскільки це необхідно для оптимальної роботи фільтра. Він визначає, як змінити функцію передачі фільтра, щоб зменшити вартість наступної ітерації. Однією з найпоширеніших функцій є середня квадратна помилка сигналу помилки.

7. Ядро Перцептрон

У машинному навчанні перцептрон ядра - це тип популярного алгоритму навчання перцептрона, який може вивчати машини ядра, такі як нелінійні класифікатори, які використовують функцію ядра для обчислення подібності тих зразків, які не бачать навчальних зразків. Цей алгоритм був винайдений у 1964 році, що робить його першим класифікатором ядра.

Більшість обговорюваних алгоритмів ядра базуються на випуклій оптимізації або власних проблемах і є статистично обґрунтованими. Їх статистичні властивості аналізуються за допомогою статистичної теорії навчання.

Якщо говорити про області застосування методів ядра, він є різноманітним і включає геостатистику, кригінг, зворотну відстань, 3D-реконструкцію, біоінформатику, хемоінформатику, вилучення інформації та розпізнавання рукописного тексту.

Висновок

Я узагальнив деякі термінології та типи методів ядра в машинному навчанні. Через брак місця ця стаття в жодному разі не є вичерпною і покликана просто зрозуміти, що таке метод ядра, та короткий підсумок їх типів. Однак висвітлення цієї статті змусить вас зробити перший крок у галузі машинного навчання.

Рекомендовані статті

Це посібник з методу ядра в машинному навчанні. Тут ми обговорюємо 7 типів методів ядра в машинному навчанні. Ви також можете подивитися наступну статтю.

- Монолітне ядро

- Кластеризація в машинному навчанні

- Машинне навчання даних з наукових даних

- Непідконтрольне машинне навчання

- PHP Фільтри | Як перевірити введення користувача за допомогою різних фільтрів?

- Повний посібник з життєвого циклу машинного навчання