Вступ до видів алгоритмів машинного навчання

Типи алгоритмів машинного навчання або обчислення ШІ - це програми (математика та обгрунтування), які змінюють себе на ефективність, оскільки вони подаються для отримання додаткової інформації. "Пристосування" деякої частини ШІ означає, що ці проекти змінюють те, як вони обробляють інформацію через деякий час, наскільки люди змінюють, як вони обробляють інформацію, навчаючись. Тож машинне навчання або обчислення ШІ - це програма з певним методом зміни власних параметрів, враховуючи критику минулих виставкових очікувань щодо набору даних.

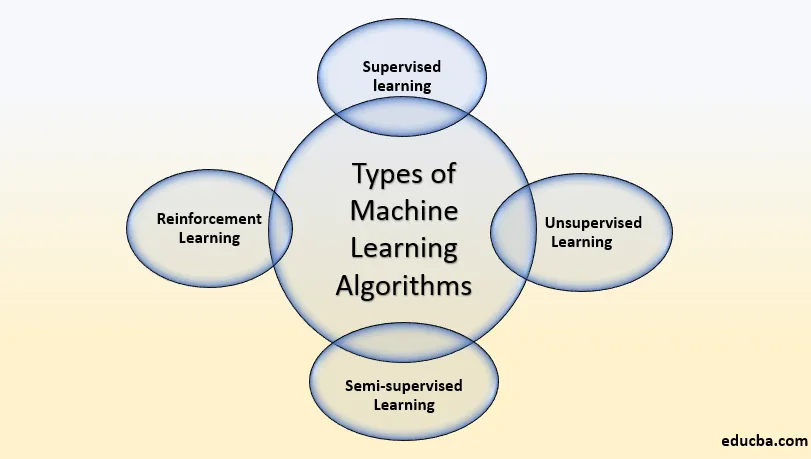

Усі типи алгоритмів машинного навчання

Їх певні різновиди, як характеризувати види типів алгоритмів машинного навчання, але, як правило, їх можна розділити на класи відповідно до їх мотивації, а основні класифікації супроводжують:

- Контрольоване навчання

- Навчання без нагляду

- Навчальне навчання

- Навчання зміцненню

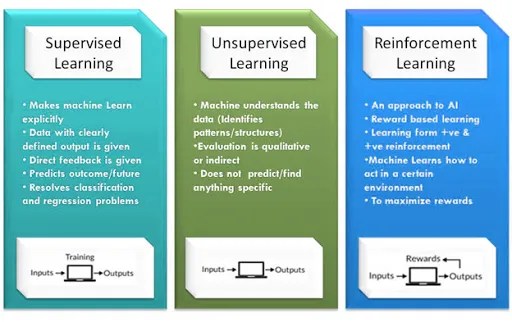

Що таке контрольоване навчання

Навчальне навчання - це те, де ви можете вважати, що навчання керується інструктором. У нас є набір даних, який працює як викладач, і його завдання полягає в підготовці моделі або машини. Коли модель готується, вона може почати узгоджуватися з очікуванням чи вибором, коли їй буде надана нова інформація.

Приклад контрольованого навчання:

- Ви отримуєте безліч фотографій з даними про те, що на них, і після цього ви навчаєте модель сприймати нові фотографії.

- У вас є багато даних про ціни на будинки, виходячи з їх розміру та місця розташування, і ви вводите їх у модель та навчаєте, тоді ви можете передбачити ціну інших будинків на основі даних, які ви годуєте.

- якщо ви хочете передбачити, що ваше повідомлення є спамом або не засноване на більш старому повідомленні, яке ви маєте, ви можете передбачити, що нове повідомлення є спамом чи ні.

Керований алгоритм навчання є таким:

1) Лінійна регресія

лінійна регресія цінна для виявлення зв'язку між двома стійкими факторами. Один є предиктором або автономною змінною, а другий - змінною реакції чи реакції. Він шукає вимірювані відносини, проте не детерміновані відносини. Кажуть, що зв'язок між двома факторами є детермінованим на випадок виключення того, що одна змінна може бути точно передана іншою. Наприклад, використовуючи температуру в градусах Цельсія, можливо точно передбачити Фаренгейт. Фактичний взаємозв'язок не є точним у вирішенні зв'язку між двома факторами. Наприклад, підключення десь в діапазоні висоти і ваги. Основна думка полягає в тому, щоб отримати лінію, яка найкраще відповідає інформації. Найкраще підходить лінія, щодо якої всеохоплююча помилка прогнозу (вся інформація фокусирується) настільки мало, як можна було б очікувати за обставин. Помилка - це розділення між точкою до лінії регресії.

2) Дерева рішень

Дерево рішень - це пристосування для вирішення, яке використовує деревоподібну діаграму чи модель рішень та їх потенційні результати, включаючи результати випадкових подій, витрати на ресурси та корисність. Вивчіть зображення, щоб зрозуміти, на що він нагадує.

3) Класифікація наївних Бейсів

Наївний Байєс класифікує групу основних імовірнісних класифікаторів, залежних від застосування теорії Байєса з сильним (неосмисленим) самоврядуванням особливостей Naive Bayes. Ця класифікація Деякі із сертифікованих моделей:

Щоб відмітити електронну пошту як спам чи не спам

Замовте новинну інформацію про інновації, урядові проблеми чи спорт

Перевірте нотку речовини, що передає позитивні емоції чи негативні настрої?

Використовується для програмування розпізнавання облич.

4) Логістична регресія

Логістична регресія - це новаторський фактичний метод демонстрації біноміального результату принаймні одним інформативним фактором. Він кількісно визначає зв'язок між абсолютною змінною вантажу та щонайменше одним вільним фактором, оцінюючи ймовірності з використанням логістичної спроможності, що є комбінованим логістичним асигнуванням.

Зазвичай регреси можуть бути використані в реальному житті, як:

Кредитний показник

Вимірювання рівня успішності ринку або компанії

Передбачити дохід будь-якої компанії або будь-якого товару

Чи в будь-який день відбудеться землетрус?

5) Звичайна регресія найменших квадратів

Найменші квадрати - це стратегія здійснення прямої регресії. пряма регресія - це започаткування підгонки лінії через безліч фокусів. Для цього існують різні потенційні процедури, і система "звичайних найменших квадратів" йде так: Ви можете провести лінію, а після цього для всіх центрів обробки даних виміряти вертикальну відрив між точкою та прямою та включити ці вгору; відповідна лінія буде місцем цього агрегату перегородок, настільки ж мізерним, як це може бути нормальним у світлі поточної ситуації.

Що таке навчання без нагляду?

Модель вчиться завдяки сприйняттю та виявляє структури в інформації. Коли моделі надається набір даних, вона, відповідно, виявляє приклади та з'єднання в наборі даних, роблячи в ньому пучки. Що він не може зробити, це додати позначки до пучка, подібне до цього не може констатувати це збір яблук чи манго, однак, це виділить кожне з яблук від манго.

Припустимо, ми показали моделі яблук, бананів та манго для моделі, тому що вона робить, зважаючи на певні приклади та з'єднання, вона робить пучки та розділяє набір даних на ці групи. Наразі, якщо інша інформація підкріплена до моделі, вона додає її до одного з виготовлених згустків.

Приклад непідконтрольного навчання

- У вас є багато фотографій 6 осіб, але без даних про те, хто на кого, і вам потрібно виділити цей набір даних на 6 груп, на кожній із фотографій однієї людини.

- У вас є частинки, частина їх - це ліки, а частина - не ви розумієте, що буде, і вам потрібен розрахунок, щоб знайти ліки.

Непідтримуваний алгоритм навчання наступний

Кластеризація

Кластеризація - важлива ідея щодо неспроможного навчання. Здебільшого йому вдається знайти структуру чи приклад під час збору не категоризованої інформації. Обчислення кластеризації оброблять вашу інформацію та виявлять характерні кластери (групи) у випадку їх наявності в інформації. Ви також можете змінити, яку кількість пучків слід розрізняти. Це дозволяє змінити деталізацію цих зборів.

Ви можете використовувати різні види кластеризації

- Вибірковий (розподіл)

- Модель: K-засоби

- Агломеративні

- Модель: Ієрархічна кластеризація

- Покриття

- Модель: Нечіткі C-засоби

- Імовірнісний

Типи алгоритму кластеризації

- Ієрархічна кластеризація

- K - означає кластеризацію

- K-NN (k найближчих сусідів)

- Аналіз основних компонентів

- Розпад самотнього значення

- Незалежний аналіз компонентів

- Ієрархічна кластеризація

Ієрархічна кластеризація

Ієрархічна кластеризація - це обчислення, яке будує пекільний порядок груп. Він починається з кожної інформації, яка присвячена власній купі. Тут дві близькі групи будуть у подібній купі. Цей розрахунок закривається, коли залишилася лише одна група.

К-означає кластеризація

K означає, що це ітеративний розрахунок кластеризації, який спонукає вас знайти найбільш вагомий стимул для кожного акценту. Спочатку вибирається ідеальна кількість груп. У цій методиці кластеризації ви повинні зібрати інформацію, яка зосереджена на k зборах. Більший k означає менше зборів з більшою зернистістю аналогічно. Нижчий k означає більші збори з меншою зернистістю.

Вихід обчислення - це збір «імен». Це дозволяє вказувати інформацію на одну з k збірок. У кластеризації k - означає, що кожен збір характеризується створенням центру для кожного збору. Центроїди - це як ядро згустку, яке ловить найближчі до них фокуси і додає їх до групи.

К-середнє кластеризація додатково характеризує дві підгрупи

- Агломераційна кластеризація

- Дендрограма

Агломераційна кластеризація

Цей тип кластеризації K-засобів починається з фіксованої кількості пучків. Він позначає всю інформацію в точну кількість груп. Ця стратегія кластеризації не потребує кількості груп K як інформації. Процедура агломерації починається з формування кожної даної як одиночної групи.

Ця стратегія використовує певний захід розділення, зменшує кількість пучків (по одному в кожному акценті), комбінуючи процес. На закінчення ми маємо одну велику групу, яка містить кожну із статей.

Дендрограма

У техніці кластеризації Dendrogram кожен рівень розмовлятиме з можливою групою. Високість дендрограми демонструє ступінь схожості між двома з’єднаними пучками. Чим ближче до основи процедури, тим вони прогресивно порівнюють групу, яка виявляє збір з дендрограми, що не характерно і здебільшого абстрактно.

K-Найближчі сусіди

K-найближчий сусід - найпростіший з усіх класифікаторів AI. Він відрізняється від інших процедур ШІ тим, що не забезпечує модель. Це прямий розрахунок, який зберігає кожен доступний випадок і характеризує нові приклади, залежні від міри подоби.

Це дуже добре працює, коли між моделями є розмежування. Коефіцієнт навчання є помірним, коли підготовчий набір величезний, а розмежування розділення нетривіальне.

Аналіз основних компонентів

За винятком випадків, що вам потрібен простір з більшими розмірами. Ви повинні вибрати причину цього простору і лише 200 найзначніших балів цього приміщення. Ця база відома як головний компонент. Підмножина, яку ви вибрали, складається з іншого простору, який має невеликі розміри, контрастний з унікальним. Він зберігає, проте, велику частину багатогранного характеру інформації, як можна було очікувати.

Що таке навчання підсиленням?

Це спроможність фахівця співпрацювати із землею та виявити, який найкращий результат. Він переслідує ідею хіта та попередньої техніки. Оператор отримує винагороду або покарає бал за правильну чи невідповідну відповідь, і виходячи з позитивних фокусів винагороди, підібраних самою моделлю поїздів. Крім того, знову підготовлений, він готується передбачити нову інформацію, що вноситься до нього.

Приклад навчання по зміцненню

- Відображення реклами, відповідно до користувачів, що не подобається, оптимізує на тривалий період

- Знайте бюджет реклами, який використовується в режимі реального часу

- зворотне підкріплення, навчившись краще знати клієнтів, як не подобається

Що таке Навчальне навчання?

Напівконтрольний вид навчання, розрахунок готується на основі поєднання іменованої та немеченої інформації. Зазвичай ця суміш міститиме обмежену кількість названих відомостей та безліч маркованої інформації. Основним методом є те, що спочатку інженер програмного забезпечення згрупує порівнянну інформацію, використовуючи неспроможний розрахунок навчання, а потім використає поточну названу інформацію, щоб назвати решту незазначеної інформації. Звичайні випадки використання такого роду обчислення мають типову властивість серед них. Отримання неозначеної інформації, як правило, є скромним, тоді як називання зазначеної інформації є надто дорогим. Природно, можна розглянути три види обчислень навчання як наглядові, усвідомлюючи те, де недосвідченість знаходиться під наглядом інструктора як вдома, так і в школі; вихователь показує пару ідей у класі та дає запити як шкільні роботи, які залежать від порівняних ідей.

Приклад навчального нагляду під наглядом

Видатно, що більше інформації = більш якісні моделі глибокого навчання (до конкретної точки ув'язнення чітко, але частіше за все ми не маємо такої кількості інформації.) Як би там не було, отримання маркованої інформації коштує дорого. У випадку, якщо вам потрібно підготувати модель для розрізнення крилатих тварин, ви можете встановити безліч камер, щоб, отже, сфотографувати птахів. Це взагалі скромно. Домовитись осіб, які позначають ці фотографії, дорого. Розгляньте можливість того, що у вас є величезна кількість фотографій крилатих тварин, однак просто замовте людей, щоб позначити невелику підмножину фотографій. Як виявилося, замість того, щоб просто тренувати моделі на позначеному підмножині, ви можете попередньо тренувати модель на всьому навчальному наборі, перед тим як налаштовувати її з названим підмножиною, і ви показуєте ознаки виконання вдосконалення за цими лініями. Це напівконтрольне навчання. Це відкладає ваші грошові кошти.

Висновок

Існує багато типів алгоритму машинного навчання, і на основі різних-різних умов ми повинні використовувати найкращий алгоритм для найкращого результату. Існує багато алгоритмів, які знаходять найкращу точність кожного типу алгоритмів машинного навчання і яка є найвищою точністю, яку ми маємо використовувати для цього алгоритму. Ми можемо мінімізувати помилки кожного алгоритму за рахунок зменшення шуму в даних. Нарешті, я скажу, що не існує жодного алгоритму машинного навчання, який би міг надати 100-відсоткову точність, навіть людський мозок не може цього зробити, щоб знайти найкращий алгоритм ялиці для ваших даних.

Рекомендовані статті

Це посібник щодо видів алгоритмів машинного навчання. Тут ми обговорюємо, що таке алгоритм машинного навчання ?, а його види включають в себе контрольоване навчання, непідконтрольне навчання, напівконтрольне навчання, посилене навчання. Ви також можете переглянути наступні статті, щоб дізнатися більше -

- Методи машинного навчання

- Бібліотеки машинного навчання

- Моделі машинного навчання

- Рамки машинного навчання

- Гіперпараметр машинного навчання

- Ієрархічна кластеризація | Агломераційна та роздільна кластеризація

- Створити дерево рішень | Як створити | Переваги

- Життєвий цикл машинного навчання | Топ 8 етапів